Γιαγιά πουλάει μαρμελάδες στην Ομόνοια. Έχει ξεφύγει το AI, βίντεο πιο ρεαλιστικά από ποτέ αλλάζουν όσα ξέραμε

Η τεχνητή νοημοσύνη φτιάχνει βίντεο που μοιάζουν αληθινά, αλλάζουν τη διασκέδαση, φέρνουν νέες απάτες και απειλούν την ίδια την έννοια της πραγματικότητας.

Τα τελευταία εικοσιτετράωρα, το διαδίκτυο πλημμυρίζει από βίντεο που σε κάνουν να σταματάς την αναπνοή σου. Πρόσωπα, κινήσεις, βλέμματα – όλα μοιάζουν αληθινά, αλλά δεν είναι. Η τεχνητή νοημοσύνη έχει ξεπεράσει το σημείο χωρίς επιστροφή. Πλέον, το ψεύτικο και το πραγματικό μοιράζονται το ίδιο καρέ, και κανείς δεν μπορεί να τα ξεχωρίσει με σιγουριά.

Το νέο μοντέλο της OpenAI, το Sora 2, είναι το πιο προχωρημένο που έχουμε δει ως τώρα. Δημιουργεί βίντεο με φυσική κίνηση, ήχο, διάλογο και φως που αντιδρά όπως στην πραγματικότητα. Μπορεί να φτιάξει ολόκληρη σκηνή δρόμου, με αυτοκίνητα που αντανακλούν το φως του ήλιου και ανθρώπους που κινούνται φυσικά, σε χρόνο μερικών δευτερολέπτων. Δίπλα του, το Veo 3 της Google αποδίδει κινηματογραφικές λήψεις με τέτοιο ρεαλισμό που θυμίζει στούντιο παραγωγής. Μιλάμε για μια στιγμή όπου η δημιουργία βίντεο παύει να είναι τέχνη και γίνεται κώδικας.

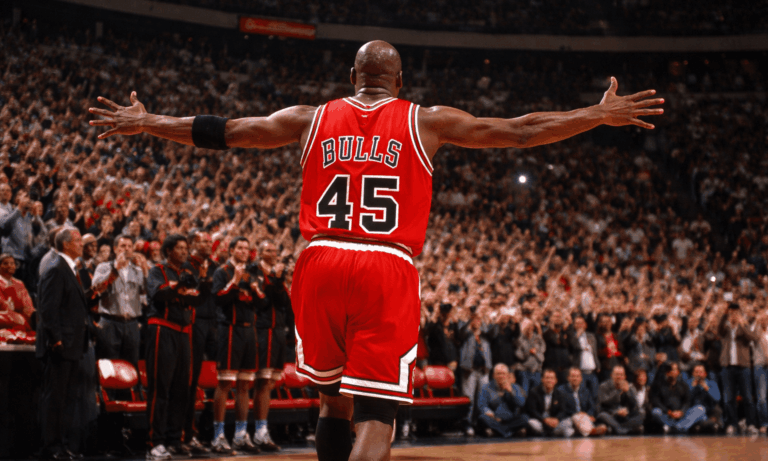

Οι πλατφόρμες αυτές δεν απευθύνονται πλέον μόνο σε επαγγελματίες. Οποιοσδήποτε μπορεί να ανεβάσει μια περιγραφή ή μια φωτογραφία και να δημιουργήσει έναν “πραγματικό” κόσμο. Οι χρήστες του Sora ανεβάζουν καθημερινά βίντεο όπου διασημότητες εμφανίζονται σε σκηνές που δεν υπήρξαν ποτέ, ενώ στο TikTok και το Instagram πληθαίνουν τα clips που παίζουν με την ίδια την έννοια της αλήθειας.

Το βίντεο με τη γιαγιά που πουλάει μαρμελάδες στην πλατεία Ομονοίας είναι ένα μόνο παράδειγμα απο τα χιλιάδες βιντεο που εχουν κατακλήσει το internet. Απο τα σχόλια καταλαβαίνεις οτι ο περισσότερος κόσμος δεν αντιλαμβάνετε οτι πρόκειται για AI, και είμαστε ακόμα στην αρχή του φαινομένου. Ενας χρήστης για παράδειγμα γράφει : “θα χρειαστεί να σου περάσω χειροπέδες, τραγικό ν σε ποιον βρε θα περάσεις χειροπέδες στην γιαγιά ?.??”

@greekaislop Για δύο μαρμελάδες ρε κτήνος #greek #fyp #fy #greekpolice #bodycam ♬ original sound – Greekaislop

Όταν η πραγματικότητα χάνει το νόημά της

Το αποτέλεσμα είναι εντυπωσιακό, αλλά και επικίνδυνο. Ήδη, το 30% της παγκόσμιας παραπληροφόρησης του 2025 προέρχεται από περιεχόμενο που δημιούργησε AI. Οι deepfake απάτες πολλαπλασιάζονται. Βίντεο με πλαστά πρόσωπα διευθυντών χρησιμοποιούνται για να εγκρίνουν εικονικές μεταφορές εκατομμυρίων. Η εταιρεία Arup έχασε 25 εκατομμύρια δολάρια σε τέτοια υπόθεση στο Χονγκ Κονγκ. Ρομαντικές απάτες, εκβιασμοί και «ψηφιακές συλλήψεις» αυξάνονται με ρυθμούς που ούτε οι αρχές δεν μπορούν να παρακολουθήσουν.

Η απειλή δεν είναι μόνο οικονομική. Είναι ψυχολογική. Αν δεν μπορείς να εμπιστευθείς ό,τι βλέπεις, τότε πώς θα πιστέψεις μια είδηση, μια ιστορική καταγραφή ή ένα ντοκιμαντέρ; Η ίδια η έννοια της ανθρώπινης εμπιστοσύνης δοκιμάζεται. Τα deepfakes έχουν τη δύναμη να αλλοιώσουν τη συλλογική μνήμη, να γράψουν ιστορία που δεν συνέβη ποτέ.

Παράλληλα, η ψυχαγωγία αλλάζει ριζικά. Ο καθένας μπορεί να γίνει σκηνοθέτης της φαντασίας του: να δημιουργήσει σειρές, ταινίες, μουσικά βίντεο, ακόμα και εικονικούς εαυτούς που ζουν διαφορετικές ζωές. Η δημιουργικότητα εκτοξεύεται, αλλά και η γραμμή μεταξύ τέχνης και ψευδαίσθησης εξαφανίζεται. Οι σκηνοθέτες μιλούν για «απελευθέρωση», οι ψυχολόγοι για «κρίση πραγματικότητας».

Η νέα γενιά εργαλείων όπως το Kling AI, το PixVerse V5 και το OmniHuman της ByteDance επιτρέπει τη δημιουργία βίντεο από μία μόνο φωτογραφία. Μπορείς να δεις τον εαυτό σου να περπατά, να μιλά ή να χορεύει, χωρίς να έχεις γυρίσει τίποτα. Η προσομοίωση δεν είναι πλέον αισθητικό εφέ· είναι μια νέα μορφή ύπαρξης.

Οι ειδικοί προειδοποιούν πως το επόμενο βήμα θα είναι η αλληλεπιδραστική ψευδαίσθηση: 3D σκηνές όπου ο χρήστης θα “ζει” μέσα σε συνθετικές εμπειρίες. Κι όταν το μυαλό αρχίσει να πιστεύει πως αυτό που βλέπει είναι πραγματικό, τότε η παραπληροφόρηση θα γίνει σχεδόν αδύνατο να εντοπιστεί.

Προσπάθειες αντιμετώπισης υπάρχουν — συστήματα “υδατογραφήματος” στα δεδομένα, αλγόριθμοι ανίχνευσης, νομικά πλαίσια. Αλλά το ψεύτικο κινείται πάντα πιο γρήγορα από την αλήθεια. Οι ειδικοί μιλούν για έναν κόσμο “μηδενικής εμπιστοσύνης”, όπου κάθε εικόνα, κάθε φωνή, κάθε video χρειάζεται απόδειξη γνησιότητας.

Το μόνο σίγουρο είναι πως βρισκόμαστε μπροστά σε μια νέα εποχή. Η εικόνα δεν είναι πια μαρτυρία· είναι επιλογή. Κι εμείς καλούμαστε να μάθουμε να βλέπουμε ξανά, αυτή τη φορά με δυσπιστία. Γιατί το ερώτημα «είναι αληθινό;» θα είναι ίσως το πιο κρίσιμο του αιώνα.